Le guide complet : mettre en place la littératie en IA dans votre organisation

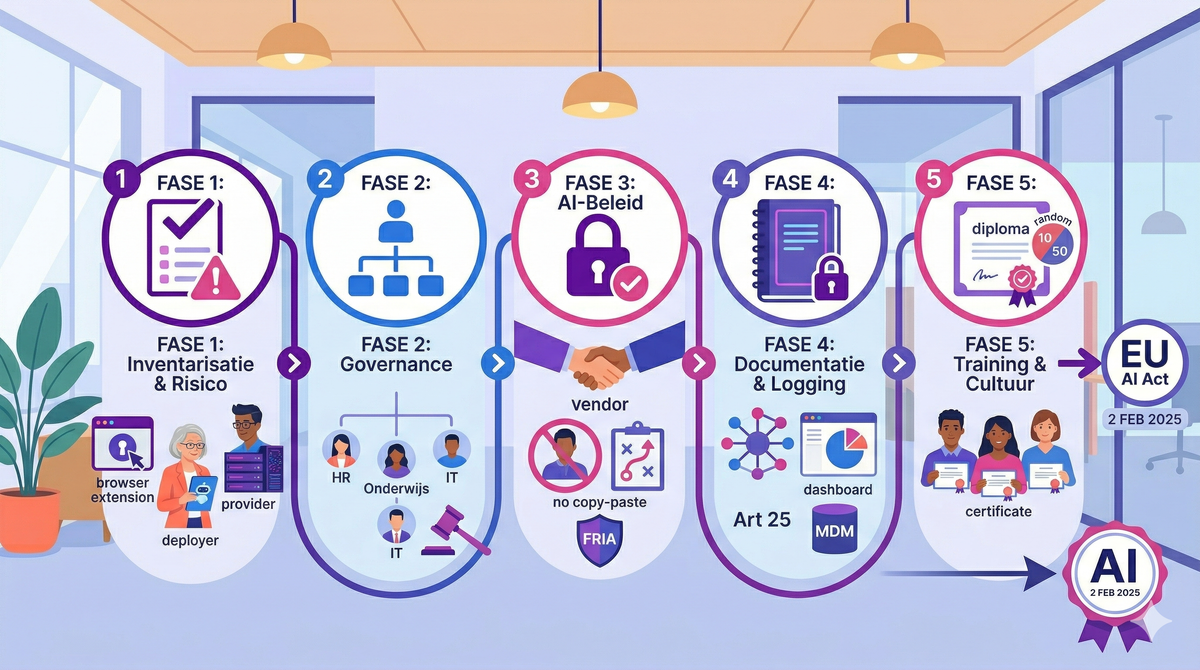

Un plan d'action structuré pour mettre en place un programme de littératie en IA conforme à l'EU AI Act.

Vous savez que la littératie en IA est obligatoire. Vous savez que l’article 4 de l’EU AI Act s’applique depuis février 2025. Mais comment passer concrètement de « nous devons faire quelque chose » à « nous l’avons mis en place et nous pouvons le démontrer » ?

Ce guide vous propose un plan d’action structuré, directement exploitable. Pas de théorie inutile, pas de jargon juridique lourd : simplement une méthode pratique pour les PME, les administrations locales et les autres organisations qui veulent mettre leur usage de l’IA en ordre de manière crédible et démontrable.

Phase 1 : inventaire (semaine 1)

Avant de former, il faut savoir ce qui existe déjà. Cela paraît évident, mais c’est précisément l’étape que beaucoup d’organisations sautent — et c’est souvent là que les problèmes commencent.

### Étape 1 : dresser un inventaire des systèmes d’IA

Recensez les systèmes d’IA utilisés dans votre organisation. Pas seulement les outils officiellement déployés, mais aussi les usages plus informels ou non validés.

Pour cela, faites au minimum trois choses :

- Demandez à votre équipe IT une liste de tous les logiciels comportant des composants d’IA : Microsoft 365 Copilot, fonctionnalités IA dans Google Workspace, CRM avec fonctions IA, outils RH, chatbots, etc.

- Demandez aux collaborateurs, via un court questionnaire ou en réunion d’équipe, quels outils ils utilisent réellement : ChatGPT, Gemini, Claude, assistants de rédaction, outils de traduction IA, extensions de navigateur, outils de résumé, etc.

- Vérifiez votre politique navigateur et vos extensions installées. Grammarly, outils de synthèse, moteurs de recherche assistés par IA ou traducteurs « gratuits » peuvent traiter beaucoup plus d’informations qu’on ne l’imagine. C’est souvent là que se cache la plus grande fuite invisible de données.

### Étape 2 : classer les usages selon le niveau de risque

Catégorisez ensuite chaque système selon la logique de l’EU AI Act :

### Étape 3 : définir les rôles

Déterminez ensuite dans quelle catégorie de rôle se situe chaque collaborateur.

Dans la plupart des organisations, 70 à 80 % des personnes sont des utilisateurs généraux. Elles ont besoin d’une formation de base : ce qu’est l’IA, quels sont les risques, et comment l’utiliser de manière responsable.

Les managers et décideurs doivent, en plus, comprendre les obligations de l’organisation, savoir comment mettre en place une politique IA et comment évaluer les risques.

Les professionnels RH qui utilisent l’IA dans le recrutement et la sélection appartiennent à une catégorie plus sensible et nécessitent une formation d’approfondissement.

Les administrateurs IT doivent comprendre comment gérer techniquement les systèmes d’IA, mettre en place la journalisation et la surveillance, et savoir à partir de quel moment un finetuning peut faire évoluer l’organisation du rôle de déployeur à celui de fournisseur.

Point d’attention important : dès qu’une organisation modifie de manière substantielle un modèle existant pour un usage propre à visée commerciale, son niveau de responsabilité peut changer fortement. Votre équipe technique doit connaître ce risque.

Phase 2 : formation (semaines 2 à 3)

Une fois l’inventaire et la segmentation réalisés, vous pouvez former de manière ciblée. Le principe clé est simple : tout le monde n’a pas besoin de la même formation, mais chacun a besoin de la bonne formation.

### Principe 1 : une approche basée sur les rôles

Une personne à l’accueil qui utilise ponctuellement ChatGPT n’a pas les mêmes besoins qu’un responsable RH qui intervient dans un processus de sélection assisté par IA. Une formation unique pour tout le monde n’est pas seulement inefficace ; elle ne correspond pas non plus à l’esprit de l’article 4, qui exige de tenir compte des connaissances, de l’expérience, de la formation et du contexte de chaque personne.

### Principe 2 : une formation pratique et reconnaissable

Les formations les plus efficaces partent de situations concrètes. Pas de théorie abstraite, mais des exemples du quotidien :

- « Un collègue colle des données clients dans ChatGPT : que faire ? »

- « Un outil d’IA rejette un candidat sur base de son code postal : est-ce acceptable ? »

- « Une extension IA installée dans le navigateur lit tout le texte affiché à l’écran : quel est le risque ? »

Plus le scénario est reconnaissable, plus l’apprentissage est utile.

### Principe 3 : évaluer et certifier

Une formation sans évaluation reste une présentation. Une évaluation sans certificat reste un exercice. Un certificat sans acquis clairs reste un simple papier.

Vous avez besoin des trois :

- une formation sérieuse ;

- une évaluation honnête ;

- un certificat précisant les compétences évaluées et les thèmes couverts par rapport à l’EU AI Act.

### Principe 4 : des modules courts

Personne n’a envie de bloquer deux heures pour une formation de conformité. Des modules courts de 20 à 30 minutes, suivis à son rythme et sur n’importe quel appareil, fonctionnent beaucoup mieux dans la réalité.

C’est précisément ainsi que les microformations d’AIAdopt sont construites : par rôle, avec des scénarios concrets, des modules courts et un certificat avec acquis explicites pour chaque fonction dans l’organisation.

Phase 3 : politique IA (semaines 3 à 4)

En parallèle de la formation — ou juste après — mettez en place une politique IA. Elle ne doit pas être longue. Deux à quatre pages suffisent, à condition qu’elles soient claires, utiles et connues de tous.

### Ce que la politique doit contenir

Une liste d’outils approuvés

Quels outils les collaborateurs peuvent-ils utiliser ? Lesquels sont explicitement exclus ?

Des règles sur les données

Quelles données peuvent être introduites dans les outils d’IA, et lesquelles ne le peuvent pas ? Noms de personnes, données clients, informations financières, données médicales : où est la limite ?

Des règles pour les informations confidentielles

Comme règle de base, il est prudent d’interdire l’introduction dans des outils publics d’éléments comme du code source interne, des plans stratégiques ou des données à caractère personnel.

Avec des outils gratuits comme ChatGPT Free ou Gemini Free, le risque que les données introduites soient utilisées dans des processus d’amélioration de modèles est réel. Avec des offres professionnelles comme ChatGPT Enterprise, Microsoft Copilot ou Claude Team, ce risque est généralement encadré autrement. Vos collaborateurs doivent connaître cette différence — et savoir clairement quelle version est autorisée dans votre organisation.

Des responsabilités claires

Qui est responsable de l’IA ? À qui les collaborateurs signalent-ils un doute, un incident ou un usage risqué ?

Des règles spécifiques pour les usages à haut risque

Si l’IA est utilisée dans le recrutement, l’enseignement, les soins ou les services publics, quelles garanties supplémentaires s’appliquent ?

Des conséquences en cas de non-respect

Pas pour sanctionner par réflexe, mais pour montrer que la politique est sérieuse et qu’elle s’inscrit dans une gouvernance réelle.

### Comment la communiquer

N’envoyez pas cette politique comme simple pièce jointe dans un e-mail que personne ne lira. Présentez-la en réunion d’équipe. Demandez aux collaborateurs de confirmer qu’ils l’ont lue et comprise. Et reliez-la explicitement à la formation IA : la politique et la formation doivent se renforcer mutuellement.

Phase 4 : documentation et preuve (en continu)

C’est souvent ici que les organisations perdent le bénéfice de leurs efforts. Elles forment, elles rédigent une politique, mais elles ne documentent pas. Or, lors d’un audit, la documentation est ce qui compte.

### Ce qu’il faut conserver

Un aperçu par collaborateur

Qui a suivi quelle formation, à quelle date, et avec quel résultat ? Conservez les certificats de manière centralisée.

L’inventaire des systèmes d’IA

Quels systèmes sont utilisés, dans quelle catégorie de risque, et qui en est responsable ?

La politique IA

Datée, validée, communiquée.

Les incidents éventuels

Si un problème survient dans l’usage de l’IA, notez ce qui s’est passé et quelles mesures ont été prises.

### Conseil pratique

Il n’est pas nécessaire d’acheter un logiciel complexe pour cela. Un aperçu central — même sous forme de tableau ou de feuille de calcul — peut suffire : nom, département, rôle, modules suivis, date, statut du certificat. Si vous reliez cela aux acquis attendus par rôle dans l’organigramme, vous obtenez déjà un tableau de bord de conformité que beaucoup d’auditeurs jugeront suffisant comme preuve de due diligence.

La plateforme de formation AIAdopt assure d’ailleurs ce suivi automatiquement. Pour chaque collaborateur, vous voyez quels modules ont été suivis, à quelle date, avec quel résultat, ainsi que les certificats directement mobilisables lors d’un audit.

Phase 5 : maintenance (annuelle)

La littératie en IA n’est pas un exercice ponctuel. La technologie évolue, le cadre réglementaire évolue, et votre organisation évolue elle aussi. Il faut donc prévoir une logique de mise à jour et de recertification.

### Après 6 mois

Faites un point de situation :

- de nouveaux outils d’IA ont-ils été introduits ?

- certains collaborateurs n’ont-ils pas encore été formés ?

- des incidents ou usages non conformes ont-ils été observés ?

### Après 12 mois

Planifiez une recertification. Les questions doivent varier — idéalement à partir d’une banque de questions — pour éviter l’apprentissage par cœur. Le contenu de formation doit lui aussi être mis à jour en fonction de l’état le plus récent de la réglementation, des outils et des pratiques.

Le résultat

Après ces cinq phases, votre organisation dispose de :

- un inventaire complet de ses usages de l’IA avec classification des risques ;

- des collaborateurs certifiés avec une littératie en IA démontrable par rôle ;

- une politique IA documentée ;

- une traçabilité exploitable lors d’un audit ;

- et, ce qui compte aussi, des collaborateurs qui utilisent l’IA de manière plus sûre, plus pertinente et plus efficace.

Ce n’est pas seulement une charge de conformité. C’est aussi un avantage opérationnel.

Vous ne devez pas faire cela seul. AIAdopt accompagne les organisations dans l’ensemble de ce parcours : inventaire, classification des risques, formations par rôle, certification et recertification. Tout ce que vous venez de lire correspond exactement à ce que nous aidons à mettre en place.

---

*Ce guide a été rédigé pour le marché belge et le sud des Pays-Bas. L’EU AI Act s’applique dans l’ensemble de l’Union européenne, mais sa mise en œuvre pratique — autorités de contrôle, règles sectorielles et procédures — varie selon les pays. Les formations AIAdopt sont spécifiquement conçues pour le contexte belge et sud-néerlandais.*

Vous voulez savoir où en est votre organisation ?

Téléchargez notre checklist de conformité gratuite à l'EU AI Act ou découvrez nos formations en littératie en IA.