L'IA dans l'enseignement : ce que le règlement IA signifie concrètement pour les écoles et les établissements d'enseignement

L'IA est entrée en un temps record dans la salle de classe — chez les élèves, chez les enseignants et dans l'administration des écoles. Admission, évaluation, détection du plagiat, apprentissage personnalisé : une grande partie relève de la catégorie à haut risque du règlement IA. Et pour les écoles, hautes écoles et universités, l'échéance d'août 2026 est plus proche qu'on ne le pense.

Pourquoi l'enseignement est une catégorie à part

Dans la perception publique, l'IA dans l'enseignement est avant tout un débat sur « ChatGPT dans les devoirs » — les élèves l'utilisent-ils, comment le détecter, ce qui est permis ou non. C'est une question importante, mais elle ne couvre pas la moitié du sujet. Pour le règlement européen sur l'IA, le centre de gravité se situe ailleurs. Le règlement s'intéresse surtout aux systèmes d'IA qui prennent des décisions concernant les élèves et les étudiants : qui est admis, qui obtient quelle note, qui est orienté vers un accompagnement supplémentaire, qui peut passer au niveau suivant.

Cela figure littéralement à l'Annexe III du règlement. L'IA dans l'enseignement relève du haut risque dès qu'elle est utilisée pour l'accès, l'affectation, l'évaluation ou la surveillance des élèves. Pour les écoles et établissements d'enseignement, cela signifie : le règlement européen sur l'IA n'est pas un phénomène périphérique, mais touche au cœur des processus d'enseignement primaires.

Ce à quoi les écoles ne pensent souvent pas

Dans les échanges avec les directions d'école et les coordinateurs pédagogiques, la même surprise revient sans cesse face au nombre d'outils existants qui relèvent de la définition d'un système d'IA selon la loi. Pensez à :

Tous ces outils, sans exception, relèvent du règlement européen sur l'IA. Pas tous du haut risque — mais beaucoup, et tous de l'obligation de base de l'Article 4.

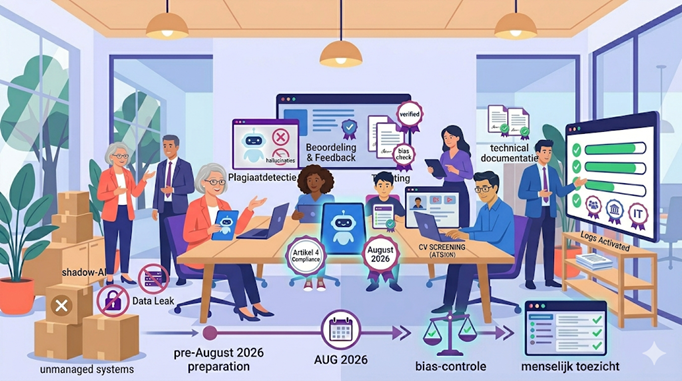

Ce qui change le 2 août 2026 pour les établissements d'enseignement

Trois choses convergent ce jour-là, spécifiquement pour l'enseignement :

Premièrement : les exigences à haut risque deviennent applicables pour toute IA utilisée dans l'évaluation, l'admission et la surveillance. Cela signifie : gestion des risques, qualité des données documentée, supervision humaine démontrablement organisée, journalisation, documentation technique, évaluation de conformité.

Deuxièmement : les parents et les élèves obtiennent des droits explicites. Un élève a le droit de savoir que l'IA a été utilisée dans une évaluation ou une décision d'admission, et peut demander des explications sur la manière dont le système est arrivé à ce résultat. En cas d'objection, une intervention humaine doit être possible. Pour les écoles qui n'ont pas prévu cela dans leurs procédures de recours, cela deviendra une conversation délicate.

Troisièmement : l'inspection de l'enseignement et les autorités nationales de surveillance de l'IA peuvent dès cette date mener activement des contrôles. En Belgique, le contrôle relève de l'inspection de l'enseignement et de l'Autorité de protection des données. Aux Pays-Bas, l'Inspection de l'enseignement travaille avec l'Autoriteit Persoonsgegevens et la future autorité de surveillance de l'IA.

La tension que ressentent les établissements d'enseignement

Ce qui rend les établissements d'enseignement uniques, c'est que l'IA y fait deux choses à la fois. D'une part, l'IA est un puissant outil pédagogique : l'apprentissage adaptatif fonctionne, le retour personnalisé fonctionne, l'exercice automatisé fonctionne. D'autre part, l'usage de l'IA à l'école touche directement à l'égalité des chances et aux trajectoires de vie des jeunes. Un algorithme qui évalue systématiquement plus bas les élèves des quartiers défavorisés, ou qui classe les élèves autistes comme ayant un « comportement déviant » lors d'un examen en ligne — ce n'est pas un problème technique, c'est un problème de justice.

Le règlement européen sur l'IA est en grande partie écrit pour cela. Non pour empêcher les écoles d'utiliser l'IA, mais pour garantir que l'usage reste responsable — avec supervision humaine, transparence envers les élèves et les parents, et contrôle démontrable des biais.

Les quatre rôles qui ont chacun besoin d'une formation propre

Une « formation IA générique pour l'équipe scolaire » ne satisfait pas à l'Article 4, et certainement pas dans un contexte où de l'IA à haut risque est déployée. En pratique, quatre groupes se distinguent :

Une école qui ne traite pas ces quatre rôles séparément ne pourra pas démontrer lors d'un contrôle que l'Article 4 a été sérieusement rempli.

Le groupe oublié : les élèves eux-mêmes

Strictement parlant, le règlement européen sur l'IA ne couvre que les collaborateurs de l'établissement. Mais les élèves et les étudiants utilisent eux-mêmes massivement l'IA — pour leurs devoirs, leurs travaux, leurs mémoires. Les écoles qui ignorent cela passent à côté de la moitié de l'histoire. Il est sage de mettre aussi la littératie en IA au programme des élèves — pas comme obligation du règlement IA, mais comme composante de la citoyenneté et des compétences numériques dans un monde où l'IA ne disparaîtra plus.

Ce que vous pouvez réalistement faire d'ici août

Pour conclure

L'enseignement est le lieu où les jeunes apprennent à réfléchir au monde dans lequel ils travailleront et vivront bientôt. Si quelqu'un doit bien comprendre comment fonctionne l'IA, où se situent les limites et comment l'utiliser de manière responsable, c'est bien la prochaine génération. Les établissements d'enseignement qui investissent dès maintenant dans la littératie en IA font donc bien plus que de la conformité — ils donnent à leurs élèves une compétence qui comptera au cours des vingt prochaines années.

Chez AIAdopt, nous avons développé l'extension sectorielle Enseignement (M3-ON) spécifiquement pour les enseignants, les directions d'école et le personnel de support dans l'enseignement primaire, secondaire et supérieur. La formation aborde les biais dans les systèmes d'évaluation, la supervision humaine lors de l'admission et de l'examen, le dialogue avec les élèves et les parents sur l'usage de l'IA, et l'articulation entre le règlement IA et le RGPD — clôturée par un certificat évalué qui mentionne les articles concernés du règlement IA.

👉 Découvrez notre approche pour l'enseignement ou composez votre pack sur mesure pour votre établissement.

Vous voulez savoir où en est votre organisation ?

Téléchargez notre checklist de conformité gratuite à l'EU AI Act ou découvrez nos formations en littératie en IA.