L'IA dans les soins de santé : ce que le règlement IA change concrètement pour les établissements de soins

Des algorithmes de triage aux urgences à l'analyse d'images assistée par IA en radiologie : l'IA a atteint les soins plus vite que la gouvernance. Le règlement IA contraint maintenant les établissements de soins à rattraper leur retard — et l'échéance d'août 2026 est plus proche que beaucoup de directions ne le pensent.

Pourquoi les soins de santé sont une catégorie à part

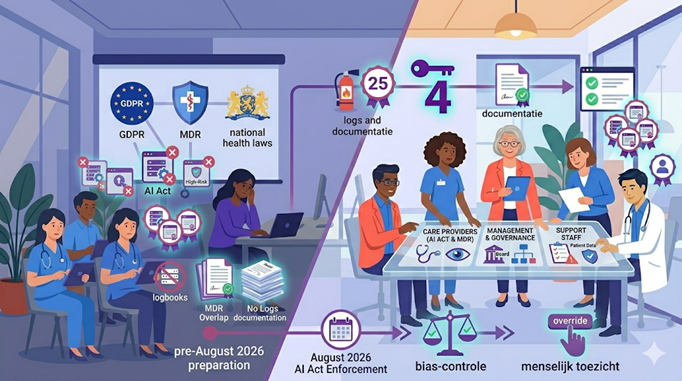

Dans presque tous les secteurs, le constat est le même : l'IA est nouvelle, la réglementation rattrape, les organisations doivent suivre. Dans les soins de santé, c'est différent. Ici, l'IA touche directement à des choses qui sont déjà profondément réglementées — sécurité des patients, prise de décision médicale, vie privée concernant le type le plus sensible de données personnelles qui existe. Le règlement européen sur l'IA n'arrive pas dans un champ vide. Il vient s'ajouter au RGPD, au Règlement relatif aux dispositifs médicaux (MDR), à la législation nationale en matière de santé et au droit disciplinaire des professionnels de la santé.

Cela fait des établissements de soins à la fois les organisations ayant le plus d'expérience en conformité et celles où la gouvernance de l'IA est la plus complexe à mettre en place. Différentes autorités regardent le même système sous différents angles, et personne ne veut être le premier à commettre une erreur dont un patient subira les conséquences.

Quelles applications d'IA relèvent du haut risque

Le règlement européen sur l'IA fonctionne avec l'Annexe III, une liste d'applications automatiquement considérées comme étant à haut risque. Pour les soins de santé, sont pertinents :

Mais le règlement ne fonctionne pas qu'avec l'Annexe III. De nombreuses applications d'IA dans les soins relèvent de la catégorie « risque limité », avec des obligations plus légères — surtout en matière de transparence envers les patients. Et même pour les applications à « risque minimal », l'obligation de l'Article 4 s'applique : tous les collaborateurs qui travaillent avec l'IA doivent être démontrablement compétents en matière d'IA.

Les applications que les établissements de soins ne perçoivent souvent pas comme de l'« IA »

Dans les échanges avec les responsables de soins et les fonctionnaires qualité, il apparaît systématiquement que la notion d'« IA » est interprétée de manière étroite. On pense à des applications spectaculaires comme IBM Watson ou les logiciels d'analyse d'images d'un fournisseur de radiologie. Mais en pratique, presque tous les établissements de soins modernes utilisent déjà :

Toutes ces applications relèvent du règlement européen sur l'IA. Pas toutes du haut risque — mais toutes des obligations de base.

Les quatre domaines que les soins doivent maîtriser avant août 2026

Premier domaine : la littératie en IA du personnel. Les soignants qui utilisent les résultats de l'IA dans des décisions concernant les patients doivent savoir ce que l'outil fait, où sont les limites, comment reconnaître les signaux d'alerte, et quand ignorer le résultat. Une infirmière qui suit aveuglément un score d'un système d'alerte précoce sans comprendre ce qu'il y a derrière constitue un risque de responsabilité — pour elle-même, pour l'établissement, et finalement pour le patient.

Deuxième domaine : supervision humaine et responsabilité finale. Pour l'IA à haut risque, il doit toujours y avoir un professionnel de la santé qui prend la décision finale et qui dispose aussi de la possibilité et du pouvoir d'écarter l'IA. « Le système l'a déterminé ainsi » n'est pas une justification valable dans une procédure disciplinaire. Le médecin ou l'infirmière reste responsable, et doit pouvoir assumer cette responsabilité concrètement.

Troisième domaine : transparence envers les patients. Les patients ont le droit de savoir quand l'IA est utilisée dans leurs soins. Pour les applications à haut risque, ils ont aussi le droit à une explication sur la manière dont le système est arrivé à son résultat. Cela touche directement au consentement éclairé, et c'est un point qui, à l'heure actuelle, n'est que peu ou pas réglé dans la plupart des brochures d'information et des procédures d'admission.

Quatrième domaine : contrats fournisseurs et chevauchement avec le MDR. De nombreux outils d'IA dans les soins sont déjà réglementés sous le MDR. Le règlement européen sur l'IA y ajoute une couche supplémentaire. La question devient alors : quelle est la responsabilité du fournisseur (provider) et quelle est celle de l'établissement (déployeur) ? Cette délimitation doit être contractuellement claire — et dans de nombreux contrats existants, elle ne l'est pas.

Les trois groupes qui ont chacun besoin d'une formation propre

Ce que vous pouvez réalistement faire d'ici août

Pour conclure

Les soins de santé ont longtemps été à l'avant-garde en matière de conformité — RGPD, MDR, NEN 7510, cadres qualité, HKZ. La conformité au règlement IA n'est, dans ce contexte, pas une charge supplémentaire, mais une extension logique de ce qui est déjà fait. La différence est que l'IA est plus récente, change plus vite et touche plus directement à des décisions que les patients ressentent dans leur chair. C'est précisément pour cela qu'il y a peu de place pour laisser ce sujet au hasard.

Chez AIAdopt, nous avons développé l'extension sectorielle Soins (M3-ZO) spécifiquement pour les soignants, l'encadrement des soins et le personnel support des établissements de soins. La formation aborde la supervision humaine en contexte clinique, l'articulation entre le règlement IA et le MDR, la transparence envers les patients, et les implications disciplinaires — clôturée par un certificat évalué qui mentionne les articles concernés du règlement IA.

👉 Découvrez notre approche pour les soins de santé ou composez votre pack sur mesure pour votre établissement.

Vous voulez savoir où en est votre organisation ?

Téléchargez notre checklist de conformité gratuite à l'EU AI Act ou découvrez nos formations en littératie en IA.