L'IA dans le recrutement et la sélection : pourquoi les RH sont devenues la fonction critique

Les outils d'IA se sont silencieusement glissés dans tous les services de recrutement ces deux dernières années. Tri de CV, analyses d'entretien, mise en correspondance des candidats — la quasi-totalité relèvent de la catégorie à haut risque du règlement IA. Et à partir du 2 août 2026, les RH deviennent la fonction où l'autorité de surveillance frappera en premier.

Pourquoi les RH sont soudainement la fonction la plus sensible de l'organisation

Jusqu'à récemment, les RH étaient pour les professionnels de la conformité avant tout un sujet RGPD. Données personnelles, contrats de sous-traitance, durées de conservation — du connu. Avec le règlement européen sur l'IA, cela change fondamentalement. Le recrutement et la sélection figurent littéralement à l'Annexe III du règlement, dans la liste des usages à haut risque. Cela signifie : ce n'est pas le service IT, ni la direction, mais le service RH qui sera bientôt l'endroit où le contrôle sera le plus strict.

Ce n'est pas un mouvement juridique abstrait. C'est la conséquence directe de quelque chose que les professionnels RH savent eux-mêmes le mieux : l'IA est devenue en deux ans le cœur battant du recrutement moderne. Et le législateur a décidé que cette seule fonction avait un tel impact sur la vie des gens que les règles les plus strictes devaient s'appliquer.

Ce que vous ne considérez peut-être pas comme de l'« IA » — mais que la loi, oui

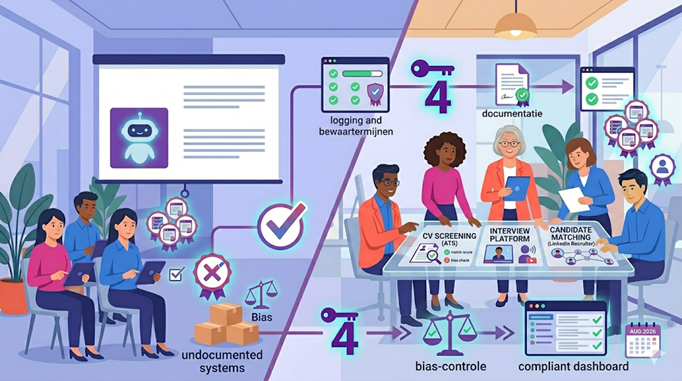

Dans les échanges avec les responsables RH, la même réaction revient presque toujours : « En fait, nous n'utilisons pas d'IA. » Et puis, en creusant, il s'avère que l'organisation travaille bel et bien avec :

Tous ces éléments sont des systèmes d'IA au sens du règlement européen sur l'IA. Et dès qu'ils sont utilisés pour le recrutement, la mobilité ou la fin d'une relation de travail, ils relèvent de l'Annexe III — haut risque.

Ce que « haut risque » signifie concrètement pour votre service RH

À partir du 2 août 2026, votre organisation doit pouvoir démontrer que pour chaque système d'IA à haut risque dans les RH, les éléments suivants sont en place :

Supervision humaine. Il doit toujours y avoir une personne capable d'écarter le résultat de l'IA, et qui est aussi formée à le faire. « Le recruteur reçoit une liste, choisit le top 5 et planifie les entretiens » n'est pas suffisant si ce recruteur n'a aucune idée de la manière dont l'IA est arrivée à cette liste ni de ce à quoi il doit prêter attention.

Transparence envers les candidats. Les candidats doivent savoir que l'IA est utilisée dans leur évaluation. Pas dans les petits caractères — clairement et au bon moment du processus. Pour l'IA à haut risque, les candidats ont en outre le droit de demander des explications sur la manière dont le système est arrivé à son évaluation.

Contrôle des biais. De manière démontrable. Comment savez-vous que votre outil de présélection ne note pas systématiquement plus bas les femmes, les seniors, les noms non occidentaux ou les personnes en situation de handicap ? « Notre fournisseur dit que le système est impartial » ne constitue pas une défense. En tant que déployeur, vous êtes vous-même tenu de tester et de documenter ce point.

Journalisation et durées de conservation. Vous devez pouvoir reconstituer quel candidat a été évalué par quel système d'IA, à quel moment et de quelle manière. En cas de plainte ou d'audit, ce dossier doit être posé sur la table.

Qualité des données. Les données avec lesquelles le système a été entraîné et celles que vous y introduisez doivent être de qualité suffisante — représentatives, exactes, pertinentes. Là encore, la charge de la preuve incombe à votre organisation, pas au fournisseur.

Les trois lignes de défense dont les RH ont désormais besoin

Une seule formation à la littératie en IA pour « tout le monde aux RH » ne suffit pas. Comme pour les autres fonctions à haut risque, il doit y avoir une différenciation :

Celui qui ne couvre pas ces trois niveaux séparément ne satisfait pas à l'Article 4 — et certainement pas aux exigences à haut risque qui s'y ajoutent.

La bombe à retardement silencieuse : les contrats fournisseurs

Quelque chose qui dort sous le tapis dans presque tous les services RH : la plupart des outils de recrutement proviennent de fournisseurs externes, et ces contrats ont été conclus il y a des années sans aucune clause sur la conformité au règlement IA. À partir du 2 août 2026, cela représente un problème. Car même si votre fournisseur se qualifie peut-être de « fournisseur », la loi vous tient vous, en tant qu'utilisateur, responsable de ce qui se passe dans votre processus de recrutement. L'ignorance ne vous dégage pas.

C'est peut-être l'action la plus importante que les RH doivent entreprendre dans les mois à venir : un audit fournisseurs. Quels outils utilisons-nous, que dit le fournisseur sur la conformité au règlement IA, quelle documentation peut-il fournir, et — point critique — quelle responsabilité peut-il assumer contractuellement ? Les fournisseurs qui se sentent mal à l'aise après une première question seront bientôt votre problème.

Ce que vous devez réalistement faire d'ici août

Pour conclure

Les RH sont passées en deux ans d'une fonction de gestion à une fonction où vont atterrir les exigences de conformité les plus lourdes. Ce n'est pas une punition — c'est une reconnaissance de l'impact considérable que le recrutement et la sélection ont sur les personnes. Les organisations RH qui prennent cela au sérieux dès maintenant ne font pas que de la conformité. Elles construisent une pratique de recrutement dans laquelle les candidats peuvent avoir confiance, et qui deviendra bientôt la norme à laquelle les autres employeurs seront comparés.

Chez AIAdopt, nous avons développé l'extension sectorielle RH (M3-HR) spécifiquement pour les recruteurs, les HR business partners et l'encadrement RH. La formation aborde la reconnaissance des biais, la supervision humaine, les exigences à haut risque sous l'Annexe III et la question des fournisseurs — clôturée par un certificat évalué qui mentionne les articles concernés du règlement IA.

👉 Découvrez notre approche pour les RH ou composez votre pack sur mesure pour votre organisation.

Vous voulez savoir où en est votre organisation ?

Téléchargez notre checklist de conformité gratuite à l'EU AI Act ou découvrez nos formations en littératie en IA.